Egy új korszak, ahol a valóság is szerkeszthető

Az AI generált hamis politikai tartalom ma már nem elméleti lehetőség, hanem valós mindennapi probléma. A gépi tanulás és a generatív MI-modellek lehetővé teszik, hogy politikai szereplők vagy kampányok olyan videókat, hangfelvételeket és üzeneteket hozzanak létre, amelyek valósnak tűnnek, pedig semmi közük a valósághoz.

2025 őszén Magyarországon is előfordult, hogy egy MI által generált videó politikai botrányt okozott. Ez a jelenség egyre nagyobb veszélyt jelent a közéletre, a média már eleve megtépázott hitelességére és a demokrácia alapjaira.

Mi az a mesterséges intelligenciával készített hamis politikai tartalom?

Minden olyan üzenet, tartalom ide sorolható, amelyet MI-algoritmus hoz létre vagy módosít politikai befolyásolás céljából. Néhány példa: Deepfake videó, hamis hangfelvétel, generált képek, MI vezérelt chatbotok által írt politikai jellegű kommentek. Sajnos zek a tartalmak a közösségi médiában rendkívül gyorsan terjednek, és sokszor nem egyszerű megcáfolni őket.

Hogyan készülnek a deepfake videók?

A deepfake (mélyhamisítás) olyan technológia, amely mélytanulással generál új képet, hangot vagy videót.

A University of Rochester kutatása szerint az eljárás a következő lépésekből áll:

Adatgyűjtés: a célzott személyről készült videók, képek és hangfelvételek összegyűjtése.

Modell betanítása: az MI megtanulja az arckifejezéseket, mozdulatokat, hangmintázatokat.

Generálás: a rendszer új videót készít, amelyben a személy olyan dolgokat „mond”, amit soha nem tett.

Terjesztés: a hamis tartalmat közösségi médiában, hírportálokon vagy chat-alkalmazásokban terjesztik.

Az így készült videók minősége már olyan magas, hogy laikus szemmel egyre inkább lehetetlen megkülönböztetni őket a valós felvételektől.

Példák az AI generált hamis politikai tartalomra

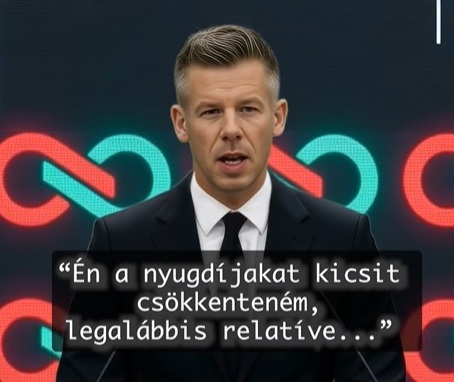

Magyarország – Magyar Péter vs Orbán Balázs

2025 októberében egy MI generált deepfake videó került fel Orbán Balázs Facebook oldalára, amelyben Magyar Péter a 13. havi nyugdíj eltörléséről beszél.

A politikus feljelentést tett hamis politikai tartalom terjesztése miatt. Ez volt az első jelentős hazai eset, amelyben MI-generált videó miatt indult jogi eljárás. Az ítélet az elkövetkezendő kampány szempontjából is érdekes lesz.

Szlovákia – választási hanghamisítás

2023-ban a szlovák választások előtt egy deepfake hangfelvétel került elő, amelyen a Progresszív Szlovákia vezetője választási manipulációról beszél. A felvétel hamisnak bizonyult, de addigra több százezer ember hallotta, ezzel a célját elérrte, a választók bizalma megingott.

Egyesült Államok – Biden hívások

2024-ben New Hampshire államban Joe Biden hamisított hangján indítottak telefonhívásokat, melyekben arra buzdították a választókat, hogy ne szavazzanak.

A hatóságok megerősítették: mesterséges intelligencia generálta a hangot, és vizsgálat indult a választói megtévesztés miatt.

Miért veszélyes a hamis politikai tartalom?

Az AI tartalmak villámgyorsan terjednek, másodpercek alatt elérhetnek milliókat, a cáfolatok viszont csak jóval később jutnak el az emberekhez.

Emellett fontos szempont a bizalo meróziója, ugyanis ha mindenről elhiszik, hogy „hamis lehet”, akkor senki sem tudja, kiben bízhat – ez rombolja a demokratikus intézményeket. Mindez növeli a társadalmi megosztottságot: az AI generált hamis politikai tartalma krendszerint az érzelmeinkre hatnak, fokozva a társadalmi polarizációt. A rossz hír az, hogy az AI generátorok fejlődése gyorsabb, mint a felismerő algoritmusoké. A Rochester Egyetem kutatói szerint a modern deepfake-ek 70 százalékát ma még azonosítani sem tudják automatikusan.

Hogyan ismerheted fel, ha egy AI generált hamis politikai tartalom kerül eléd?

1. Vizsgáld meg a forrást

Mindig ellenőrizd, honnan származik a videó. Ha ismeretlen felhasználótól jön vagy nincs hitelesített forrás, légy óvatos.

2. Figyelj a részletekre

Az MI-videók gyakran „túl tökéletesek”. Figyeld a szemek mozgását, a száj és a hang szinkronját, a fényviszonyokat.

A gépi hang sokszor steril, monoton, hiányoznak belőle a természetes beszédre jellemző szünetek és hibák.

3. Keresd vissza a forrást, használj AI detektorokat:

Használd a Google Lens, TinEye vagy InVID Verify eszközöket. Ezekkel kiderítheted, szerepelt-e a videó máshol korábban, melyet csak újrafelhasználtak a deepfake során. Használj AI detektorokat: Deepware Scanner, Hive Moderation

Mit tegyél, ha gyanús politikai videót látsz?

Ne oszd meg azonnal – ne növeld a terjedését.

Ellenőrizd több forrásból – pl. AFP Factual, Reuters Fact Check.

Jelezd a platformnak – a Facebook, TikTok, X már kínál „hamis információ” jelentési opciót.

Tarts mértéket a megosztásokban – a manipuláció gyakran az érzelmekre épít.

Oktasd a környezetedet – minél többen ismerik fel a jeleket, a manipuláció annál kevésbé lesz hatékony.

Az AI generált hamis politikai tartalmak korában a legfontosabb védekezés a kritikus gondolkodás és a digitális tudatosság.

A magyar, szlovák és amerikai példák mind azt mutatják: az MI-vel készült manipulációk valós veszélyt jelentenek a demokráciára, és komoylan kell vennünk a védekezést mind egyéni, mind közösségi szinten.

A jövőben nem az lesz a kérdés, hogy „valódi-e a videó”, mivel ezt egyre neehezebb megállapítani, hanem az, hogy megbízható-e a forrás.

A technológia fejlődése megállíthatatlan, de a hiteles információ védelme rajtunk múlik.